AI technology and, in particular, generative AI tools (especially so-called large language models) can support teachers in preparing lessons, for example in the following use cases:

The benefits of using AI tools to prepare lessons can be the rapid generation of ideas or the facilitation of routine activities, which in turn can lead to the teacher being able to spend more time on individualised support for their students. However, it should always be noted that the results are not always correct and AI-based tools do not always generate objective and neutral outputs.

(© Steirische Hochschulkonferenz 2023, Künstliche Intelligenz zur Unterrichtsvorbereitung verwenden; the above text was partly taken verbatim from the use case.)

If you are a lecturer at CAMPUS 02 and would like to know more about the use of AI technologies, the effective use of prompts or ethical issues in connection with AI tools, please contact the Centre for Unversity Didactics (ZHD) and arrange a personal appointment with our experts.

The use of AI in teaching can enrich teaching and support students in achieving their learning objectives - both in joint, teacher-led use in the (online) classroom and during asynchronous phases or in self-study.

When used and guided correctly by the teacher, generative AI language tools in particular are characterised by flexibility (chatbots are available at all times), ease of use and speed in answering questions. Large language models can also enable individualised learning for students, for example by providing feedback, assistance or translations. Interactive teaching and learning scenarios can also be created and implemented with the help of generative AI tools. The teacher can comment on and evaluate the students' communication with the language tools and reflect on it together with the learners.

When students are expected to use AI tools in class or during asynchronous learning phases, they should first learn about responsible AI usage. Additionally, the lecturer themselves must try out the use of AI tools beforehand and test the planned implementation. In this context, lecturers should consider redefining the teaching and learning objectives. Students and lecturers must be aware that content generated by generative AI tools may be prone to errors and should be verified for accuracy.

For data protection reasons, lecturers must refrain from obliging students to use AI tools such as ChatGPT without being asked. The free version of ChatGPT requires registration, the tool stores personal data and input may be used for training purposes. Platforms such as fobizz can be an alternative.

Lecturers at CAMPUS 02 UAS are encouraged to issue so-called ‘Rules for Tools’ in their courses (an example of this are the Rules for Tools by Prof. Dr. Spannagel of the Heidelberg University of Teacher Education, who chooses a proactive approach to the use of AI in teaching) in order to be completely transparent about how they handle the use of AI in their courses.

(© Steirische Hochschulkonferenz 2023, Generative KI-Sprachmodelle zur Individualisierung der Lernprozesse einsetzen. The above text was partly taken verbatim from the use case).

If you are a lecturer at CAMPUS 02 and would like to know more about the use of AI technologies, the effective use of prompts or ethical issues in connection with AI tools, please contact the Centre for Unversity Didactics (ZHD) and arrange a personal appointment with our experts.

The need to promote skills in the field of artificial intelligence (AI) in all degree programmes at universities is being emphasised in business and science. It is also important for lecturers to engage with the topic of AI at an early stage. Even if lecturers identify gaps in their own knowledge on the subject of AI, they should still familiarise themselves with artificial intelligence together with their students. We recommend that teachers build up a basic understanding of AI in their respective subject area through training, experimentation and peer learning.

Important competences related to AI are often referred to in the literature as AI literacy. A common definition of AI literacy describes it as a set of competences that enable individuals to critically evaluate AI technologies, communicate and collaborate effectively with AI and use AI as a tool online, at home and at work (Long & Magerko, 2020). AI literacy skills can be summarised as awareness, use, evaluation and ethics (Carolus et al., 2023).

Awareness beschreibt die Fähigkeit, verschiedene KI-Tools Awareness describes the ability to recognize various AI tools, to be aware of where AI could be used, and to understand how AI can be identified. Utilization means that AI can be applied to solving individual problems through structured approaches, precise prompting, and the correct choice of AI. Regarding competency evaluation, teachers can critically reflect on the input and output, identify potential errors, and apply scientific methodology to AI in terms of objectivity, reliability, and validity. With competencies in ethics, educators are able to discuss legal frameworks such as data protection and copyright, as well as consider potential biases of AI in their application.

The promotion of AI application in everyday work can be ensured through cognitive apprenticeship, reflection aids for AI ethics, and increasing AI awareness through regular discussions.

Carolus, A., Koch, M. J., Straka, S., Latoschik, M. E. & Wienrich, C. (2023). MAILS – Meta AI literacy scale: Development and testing of an AI literacy questionnaire based on well-founded competency models and psychological change- and meta-competencies. Computers in Human Behavior: Artificial Humans, 1(2), 100014. https://doi.org/10.1016/j.chbah.2023.100014

Long, D. & Magerko, B. (2020). What is AI Literacy? Competencies and Design Considerations. CHI ’20: Proceedings of the 2020 CHI Conference on Human Factors in Computing Systems, 1–16. https://doi.org/10.1145/3313831.3376727

(© Steirische Hochschulkonferenz 2024, KI-Kompetenzen vermitteln; the above text was partly taken verbatim from the use case.)

If you're a faculty member at CAMPUS 02 UAS and want to learn more about enhancing your AI competencies and those of your students, feel free to contact the Centre for Unversity Didactics (ZHD) and schedule a personal appointment with our experts.

Nicht nur bei der Vorbereitung des Unterrichts oder während synchroner Lehreinheiten, auch betreffend Arbeitsaufträge müssen Lehrende sich mit dem Einfluss von KI-Tools auseinandersetzen. Während KI-Technologien für schriftliche Paper-Pencil-Klausuren vor Ort oder mündliche Prüfungen keine Rolle spielen werden, müssen sich Lehrende bei anderen Leistungen der Studierenden des potenziellen Einflusses von KI-Modellen bewusst sein. Vor allem für Hausarbeiten oder schriftliche Arbeiten ist es daher notwendig, Rules for Tools zur formulieren und diese den Studierenden transparent zu kommunizieren.

Zudem kann eine Anpassung der Methoden der Leistungsbeurteilung überlegenswert sein, wie beispielsweise:

Ist der Einsatz von KI-Tools im Rahmen der Leistungserbringung ausdrücklich gestattet oder erwünscht (Antworten von generativen KI-Tools könnten beispielsweise von Studierenden durch immer wieder optimierte Prompts nachvollziehbar generiert und in Folge analysiert oder mit von den Studierenden selbst erstellten Antworten verglichen und evaluiert werden), ist den Studierenden genau vorzugeben, ob und wie der Einsatz offengelegt werden muss.

Der verlässliche, eindeutige und rechtssichere Nachweis zur Identifizierung KI-generierter Texte bleibt nach derzeitigem Wissensstand problembehaftet; daher raten wir zum derzeitigen Zeitpunkt vom Einsatz von Detektionssoftware für die Beurteilung ab.

Zudem möchten wir darauf hinweisen, dass Prüfungsleistungen von Studierenden urheberrechtlich geschützt sind und zur Beurteilung nicht in eine KI-Software eingepflegt werden dürfen, wenn die Software die Daten z.B. zum Training nutzt oder anderweitig verwendet. Bewertungen von Prüfungsleistungen sind prinzipiell von den Lehrenden selbst vorzunehmen – KI-Tools könnten dabei wiederum als Hilfsmittel (z.B. für die Formulierung von Feedback) verwendet werden.

Gimpel, H., Hall, K., Decker, S., Eymann, T., Lämmermann, L., Mädche, A., Röglinger, M., Ruiner, C., Schoch, M., Schoop, M., Urbach, N., Vandirk, S. (2023): “Unlocking the Power of Generative AI Models and Systems such as GPT-4 and ChatGPT for Higher Education: A Guide for Students and Lecturers”. University of Hohenheim. [Online] http://opus.uni-hohenheim.de/volltexte/2023/2146/pdf/dp_2023_02_online.pdf

Salden, P. & Leschke, J. (Hrsg.) (2023): „Didaktische und rechtliche Perspektiven auf KI-gestütztes Schreiben in der Hochschulbildung“. Zentrum für Wissenschaftsdidaktik [Online] https://doi.org/10.13154/294-9734

Rudolph, J., Tan, S., Tan, S. (2023): „ChatGPT: Bullshit spewer or the end of traditional assessments in higher education?”. Journal of Applied Learning & Teaching, 6.1. [Online] https://journals.sfu.ca/jalt/index.php/jalt/article/view/689/

Die Fachhochschule CAMPUS 02 bekennt sich hier zu verantwortungsvoller Forschung unter Berücksichtigung einer aufrichtigen und transparenten Kommunikation, zu einer hohen Verlässlichkeit bei der Durchführung von Forschungstätigkeiten, zu einem unparteilichen Verhalten und Urteilen sowie zum verantwortungsvollen Umgang mit Forschungspartner*innen. (vgl. ÖAWI 2015: 4)

Im Rahmen wissenschaftlicher Arbeiten müssen Studierende im Zuge der Beschreibung der methodischen Vorgehensweise die Verwendung von KI-Tools offenlegen. Dabei sind die verwendeten Tools, die jeweils verwendete Version, verwendete Plug-Ins sowie die Einsatzzwecke der KI in der betreffenden Arbeit (z.B. Quellensuche, Ideengenerierung, sprachliche Hilfestellung, Gliederung, „Korrekturlesen“, Visualisierung, Testung von Fragebögen etc.) zu beschreiben. Wird ein KI-Tool zur Verbesserung der sprachlichen Formulierung verwendet, so ist dies auch im Rahmen der Beschreibung der Methoden anzugeben, muss im Fließtext jedoch nicht kenntlich gemacht werden. Die Departments haben den Studierenden genaue Vorgaben betreffend Inhalt und Aufbau der Beschreibung der Methoden zu machen.

Die FH CAMPUS 02 bekennt sich zur klaren Offenlegung der Verwendung von generativen KI-Tools, die über die rein sprachliche Bearbeitung von Texten hinausgeht; wichtig ist hierbei die eindeutige Trennung zwischen der Zitation herkömmlicher Quellen und der Offenlegung der KI-Nutzung.

Wenn Sie Lehrperson an der FH CAMPUS 02 sind und wissenschaftliche Arbeiten betreuen, stimmen Sie die genaue Vorgehensweise bitte mit Ihrem Department ab.

ÖAWI (2015): „Richtlinien der Österreichischen Agentur für wissenschaftliche Integrität zur Guten Wissenschaftlichen Praxis“. Österreichische Agentur für wissenschaftliche Integrität. Wien

Effizienzsteigerung: Unterstützung bei der Unterrichtsvorbereitung, Weiterbildung und Kreativität; Automatisierung von administrativen Aufgaben. Adaptive Lernpfade können einfacher erstellt werden.

Arbeitswelt: KI wird benötigt, um wettbewerbsfähig zu bleiben

Barrierefreiheit: in Lehr- und Lernsettings durch einfache Übersetzungen von Text und Audio und Transkriptionen

Personalisierung: Neue Lernmethoden sind mit KI möglich. Lernprozesse und Feedback kann mit KI individualisiert werden und ist jederzeit verfügbar.

Forschung: Neue Forschungsmethoden und -Anwendungen können zu einem Fortschritt in F&E führen.

Datenschutz: Es sollte vermieden werden, sensible und personenbezogene Daten in Systeme einzugeben, in denen der Datenschutz nicht gewährleistet ist. Die Daten in vielen Tools werden in Amerika verarbeitet und unterliegen niedrigeren datenschutzrechtlichen Standards.

Urheberrecht: Lehrende müssen davon absehen, urheberrechtlich geschützte Werke oder Texte von Studierende in Prompts einer KI einzugeben.

Biases: Anwendung von Stereotypen und Verringerung von Diversität

Digital Divide: Nicht alle Studierenden sind in der Lage, Premium-Funktionen von KIs zu erwerben und dadurch einen Vorteil zu erhalten. Lehrende müssen deshalb auf den Einsatz von Unterrichtsmethoden und Tools achten, die von allen Studierende mit den gleichen Chancen genutzt werden können.

Prüfungssituationen: Studierende können KI in bestimmten Prüfungssituationen anwenden. Leistungsbeurteilungsmethoden sollten angepasst werden.

Transparenz: Die Verarbeitung und Nutzung von Daten, die Art der Trainingsdaten und Datensets sind häufig nicht einsehbar oder nachvollziehbar (Black Box).

Der für alle Lehrenden der FH CAMPUS 02 kostenlos zugängliche Online-Kurs Lehren an der FH CAMPUS 02 verfügt über eine Lektion zum Thema KI in der Lehre. Darin wird auf technische und historische Grundlagen der KI eingegangen sowie auf den Einfluss von KI auf die Lehre und das Lernen von Studierenden. Außerdem werden hilfreiche KI-Tools und Plattformen mit Tutorials für verschiedene Anwendungsfälle von Lehrenden und Studierenden vorgestellt.

Zudem bietet das ZHD Workshops für Lehrende an. In diesen Workshops werden Möglichkeiten zum Einsatz Künstlicher Intelligenz in der Lehre aufgezeigt sowie diskutiert, welche Herausforderungen KI mit sich bringt und wie wir mit diesen umgehen können.

Bereits veranstaltet wurde ein KI-Frühstück mit spannenden Diskussionen zum Thema KI in der Lehre und eine Weihnachtsaktion advent.event, in der neue KI-Tools vorgestellt wurden. Zudem gab es eine sehr erfolgreiche Veranstaltung Didaktik im Fokus – KO vs. KI mit einer spannenden Keynote und anschließender Podiumsdiskussion über die Thematik. All diese Veranstaltungen finden Sie in den Blogbeiträgen unter Veranstaltungen.

Der Umgang mit KI-Tools kann Studierende in ihren Lernprozessen unterstützen und diese individueller gestalten. Die KI kann beispielsweise als Study Buddy, sokratische Gegnerin oder Ideengeberin fungieren und eröffnet somit ein weites Spektrum an Möglichkeiten für Lernende. Studierende sollten aber auch beachten, dass KI-Programme nicht unfehlbar sind – es liegt an den Studierenden, alle Aussagen der KI-Tools auf ihre Richtigkeit zu überprüfen. Die Verwendung von KI in der Lehre wird von der Lehrperson im Rahmen der Rules for Tools definiert – der Gebrauch der Tools muss jedenfalls mit der Lehrperson abgestimmt werden.

Was die Erstellung schriftlicher Arbeiten betrifft, so dürfen von der KI erstellte Inhalte, die über die rein sprachliche Bearbeitung von Texten (z.B. Rechtschreibkorrektur, Umformulierung, Übersetzung) hinaus gehen, in schriftlichen Arbeiten nicht als eigener Text ausgegeben werden. Eine Verwendung in diesem Sinne gebietet die akademische Redlichkeit. Das Ausgeben von KI-generierten Inhalten als eigenen Text wird laut Prüfungsordnung dem Ghostwriting gleichgestellt.

Wenn Sie Studierende*r an der FH CAMPUS 02 sind und Fragen zur Verwendung von KI im Unterricht oder der Leistungsbeurteilung haben, wenden Sie sich an ihre*n Lektor*in oder Ihren Studiengang.

Empfehlungen für den Umgang mit KI finden Sie hier: https://www.campus02.at/wp-content/uploads/2023/08/Empfehlung-zum-Umgang-mit-KI-Studierende_010923.pdf

Selbstgesteuertes Lernen: KI kann Studierenden helfen, ihre Lernprozesse zu steuern und zu organisieren, indem sie ihnen ermöglicht, ihren Fortschritt zu verfolgen und ihre Lernziele anzupassen.

Zugang zu globalen Ressourcen: KI kann den Studierenden Zugang zu einer Vielzahl von globalen Lernressourcen und -materialien bieten, was ihre Lernerfahrung bereichern kann.

Arbeitserleichterung: Repetitive Aufgaben können von der KI übernommen werden, beispielsweise können Transkriptionen von Audiodateien erstellt werden.

Textproduktion: KI kann helfen, sprachliche und inhaltliche Verbesserungen von Texten herbeizuführen.

Kreativität: KI kann im sokratischen Dialog helfen, Ideen zu vertiefen und zu verfeinern. Es besteht die Möglichkeit, viele Daten zusammenzufassen, Brainstorming zu betreiben und neue Kreationen in Text und Bild zu schaffen.

Qualität: Richtig angewendet kann die KI qualitativ hochwertige Produkte schaffen, die in diesem Detailgrad ohne diese Wochen oder Monate gedauert hätten.

Falschaussagen und Plagiate: Häufig werden Falschaussagen generiert, Zitate erfunden und halluziniert. Studierende sind eigenverantwortlich für alle Leistungen, die sie einreichen, egal wie diese zustande kommen. Es kann zudem unwissentlich aus fremden Werten zitiert werden, sodass ein Plagiat vorliegen könnte.

Datenschutz: Es sollte vermieden werden, sensible und personenbezogene Daten in Systeme einzugeben, in denen der Datenschutz nicht gewährleistet ist. Die Daten in vielen Tools werden in Amerika verarbeitet und unterliegen niedrigeren datenschutzrechtlichen Standards.

Urheberrecht: Studierende müssen es vermeiden, urheberrechtlich geschützte Werke in Prompts einer KI einzugeben.

Biases: Anwendung von Stereotypen und Verringerung von Diversität

Digital Divide: Nicht alle Studierenden sind in der Lage, Premium-Funktionen von KIs zu erwerben und dadurch einen Vorteil zu erhalten. Lehrende müssen deshalb auf den Einsatz von Unterrichtsmethoden und Tools achten, die von allen Studierende mit den gleichen Chancen genutzt werden können.

Prüfungssituationen: Studierende können KI in bestimmten Prüfungssituationen anwenden. Leistungsbeurteilungsmethoden sollten angepasst werden.

Transparenz: Die Verarbeitung und Nutzung von Daten, die Art der Trainingsdaten und Datensets sind häufig nicht einsehbar oder nachvollziehbar (Black Box).

KI in der Forschung und Entwicklung:

Künstliche Intelligenz (KI) spielt eine zunehmend zentrale Rolle in der Forschung und Entwicklung (F&E) über verschiedene Disziplinen hinweg. Die wesentlichen Beiträge der KI in einer kurzen Übersicht:

Insgesamt beschleunigt und verbessert KI die Forschung und Entwicklung durch Effizienzsteigerungen und der Realisierung bisher zu komplexer Lösungswege.

KI braucht fundiertes Wissen, um in der F&E eingesetzt zu werden

Künstliche Intelligenz hat das Potenzial, die Forschung und Entwicklung erheblich zu transformieren, jedoch gibt es auch kritische Aspekte, die berücksichtigt werden müssen:

Zusammenfassend birgt KI neben Chancen für die F&E auch signifikante Risiken und Herausforderungen. Es ist daher entscheidend, diese kritisch zu evaluieren und das erforderliche Know-how aufzubauen, um das volle Potenzial von KI verantwortungsvoll und nachhaltig nutzen zu können.

KI in der F&E an der FH CAMPUS 02

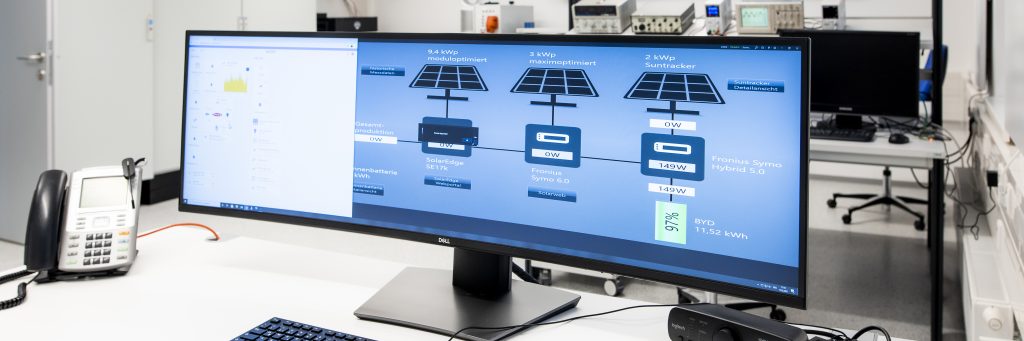

Die Vorteile durch die Integration von KI Unterstützung in die Forschungsprozesse werden auch bei der FH CAMPUS 02 genutzt. In den verschiedenen Themenbereichen finden diese naturgemäß mit unterschiedlichsten Tools und Ausprägungen Anwendung.

Die klassischen Themen wie Machine Learning, Optimierungsaufgaben und auch Simulationsoptimierung findet sich in der Automation Technology wieder.

Im Innovationsbereich werden verschiedene KI-Tools zur Unterstützung von KMU im Innovationsprozess eingesetzt.

Im Themenfeld Rechnungswesen und Controlling werden verschiedenste Optionen analysiert, wie KI-Anwendungen die Aufgabestellungen von KMU in diesem Bereich unterstützen könnten.

Im Bereich Marketing und Sales gilt es, Datenanalysen KI gestützt zu optimieren (Web Crawling). Verschiedenste Trendanalysen werden ebenfalls immer stärker KI gestützt durchgeführt werden.

Im Schwerpunkt Business Informatics wird die KI zur Datenaufbereitung, Datenanalyse und Datensimulation eingesetzt. Diese Anwendungen auf Daten und Datenströme gelten grundsätzlich für alle Themenfelder quer über die fünf Departments.

Rolle der KI am Beispiel des „Machine learning“:

Künstliche Intelligenz (KI) spielt eine fundamentale Rolle im Bereich des „Machine Learning“ (ML) und treibt dessen Fortschritte in folgenden Bereichen wesentlich voran, was zu präziseren, skalierbareren und anpassungsfähigeren ML-Anwendungen führt:

Die wissenschaftliche Weiterentwicklung im Einsatz von KI zur Unterstützung der Forschungsarbeiten findet in der Projektserie DIGIKOMP statt. Die Möglichkeiten der Einbindung von KI in die Themen der Forschungsschwerpunkte werden in diesem Projekt gescreent, getestet und entsprechend evaluiert, um mit der erforderlichen Zuverlässigkeit in die Forschungstätigkeit übernommen zu werden.

Alle Bilder wurden mit KI erstellt.

CAMPUS 02 University of Applied Sciences

Center for University Didactics

Körblergasse 126, 8010 Graz